Lakehouse: Arsitektur Kunci Mengubah Data Mentah Menjadi Bahan Bakar Super untuk AI

September 12, 2025

Di era digital yang serba cepat ini, data telah menjadi aset paling berharga bagi setiap organisasi. Namun, volume data yang masif, variasi bentuknya, dan kecepatan perubahaya seringkali menjadi tantangan besar. Terlebih lagi ketika data tersebut harus diolah dan dimanfaatkan untuk memberdayakan kecerdasan buatan (AI) yang cerdas dan efisien. Di sinilah arsitektur Lakehouse muncul sebagai game-changer, menjanjikan solusi revolusioner untuk mengubah data mentah yang berantakan menjadi “bahan bakar” berkualitas tinggi yang siap digunakan oleh model AI.

Artikel ini akan membahas secara mendalam bagaimana Lakehouse menjembatani kesenjangan antara kebutuhan penyimpanan data besar dan tuntutan analitik serta AI, serta peran krusialnya dalam mendorong inovasi AI.

Sebelum kita menyelami solusi Lakehouse, penting untuk memahami tantangan fundamental yang dihadapi perusahaan dalam memanfaatkan data untuk AI:

Baik data lake tradisional (yang menyimpan data mentah tanpa skema) maupun data warehouse (yang menyimpan data terstruktur untuk BI) memiliki keterbatasan dalam memenuhi semua kebutuhan AI secara holistik.

Lakehouse adalah arsitektur data baru yang menggabungkan keunggulan data lake (skalabilitas, fleksibilitas untuk data mentah, biaya rendah) dengan keunggulan data warehouse (struktur, kualitas data, skema, transaksi ACID, performa analitik). Intinya, Lakehouse memungkinkan perusahaan untuk menyimpan semua jenis data mentah di data lake yang hemat biaya, namun juga menambahkan lapisan manajemen data yang memungkinkan data tersebut diorganisir, dikelola, dan diakses dengan kualitas layaknya data warehouse.

Fitur-fitur utama Lakehouse meliputi:

Peran Lakehouse dalam memberdayakan AI sangat transformatif. Berikut adalah beberapa mekanisme kuncinya:

Lakehouse mengeliminasi kebutuhan akan duplikasi data atau pergerakan data yang kompleks antara data lake dan data warehouse. Semua data, baik mentah maupun yang telah disaring, berada di satu tempat yang logis. Ini menyederhanakan pipa data, mengurangi latensi, dan memastikan bahwa model AI selalu dilatih dengan data terbaru dan terlengkap.

Dengan kemampuan transaksi ACID, skema yang dapat diterapkan, dan versioning data, Lakehouse memastikan bahwa data yang digunakan untuk pelatihan AI adalah bersih, konsisten, dan andal. Ini sangat krusial karena model AI yang “lapar data” membutuhkan pasokan data berkualitas tinggi untuk belajar dan membuat prediksi yang akurat. Tata kelola data yang kuat juga membantu melacak silsilah data (data lineage) dan memastikan kepatuhan.

Model AI seringkali membutuhkan berbagai jenis data—dari teks tidak terstruktur hingga gambar, video, dan data numerik terstruktur. Lakehouse mampu menyimpan dan mengelola semua format ini secara efisien. Selain itu, ia mendukung berbagai beban kerja AI, mulai dari eksplorasi data oleh ilmuwan data, rekayasa fitur (feature engineering), pelatihan model, hingga inferensi model secara real-time.

Lakehouse menggunakan optimasi penyimpanan, pengindeksan, dan caching yang cerdas untuk mempercepat akses ke data. Ini sangat penting untuk pelatihan model AI yang seringkali melibatkan iterasi berulang pada dataset yang sangat besar. Waktu pelatihan yang lebih cepat berarti siklus pengembangan AI yang lebih cepat dan kemampuan untuk bereksperimen dengan lebih banyak model.

Dengan memanfaatkan penyimpanan objek cloud yang hemat biaya untuk menyimpan data mentah dalam skala petabyte, Lakehouse menawarkan solusi yang jauh lebih terjangkau dibandingkan data warehouse tradisional. Namun, ia tetap menyediakan kinerja dan fitur yang setara dengan data warehouse ketika diperlukan untuk analitik dan AI, menjadikaya pilihan yang sangat skalabel dan hemat biaya.

Dengan data yang bersih, terorganisir, dan mudah diakses, tim data science dapat lebih fokus pada pengembangan dan penyempurnaan model AI, daripada menghabiskan waktu berjam-jam untuk persiapan data. Kemampuan untuk dengan cepat mencoba hipotesis baru, melatih model dengan dataset yang beragam, dan mengulang proses dengan efisien adalah pendorong utama inovasi AI.

Arsitektur Lakehouse bukan sekadar tren teknologi, melainkan fondasi krusial bagi masa depan data dan kecerdasan buatan. Dengan menjembatani kesenjangan antara data lake yang fleksibel dan data warehouse yang terstruktur, Lakehouse secara fundamental mengubah cara organisasi mengelola, memproses, dan memanfaatkan data. Ini memungkinkan data mentah yang sebelumnya kurang dimanfaatkan untuk diubah menjadi “bahan bakar super” yang bersih, andal, dan siap untuk memberdayakan model AI yang semakin canggih. Bagi organisasi yang ingin memaksimalkan potensi AI mereka, mengadopsi Lakehouse bukan lagi pilihan, melainkan keharusan strategis.

Dunia teknologi sedang bergerak cepat memasuki era Gene...

September 10, 2025

As businesses increasingly rely on data to inform decis...

March 25, 2023

In today's world, data is the lifeblood of businesses. ...

March 26, 2023

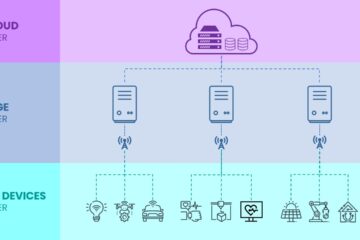

The Internet of Things (IoT) is rapidly expanding, with...

March 26, 2023

Definitions Once upon a time, businesses relied on c...

March 26, 2023

In today's fast-paced business environment, data is the...

March 26, 2023